2025年1月20日,DeepSeekAI开源了DeepSeek R1推理大模型,其性能接近OpenAI的o1模型,APP迅速占领了各大应用市场的前列,火爆程度一度让其网络服务不顺畅。如今AI语言大模型能协助我们完成很多文字、程序等方面的工作,AI大模型一直以来给我的印象是需要大算力服务器阵列或GPU阵列,DeepSeek开源大模型的出现让我对AI大模型的算力要求有所改观,尝试在自己的电脑上也部署一个AI语言大模型,用来脱机使用、学习研究。下面就分享一下我自己的经验,过程很简单,但注意的一点要学会科学上网。

需要用到一个软件GPT4All,是一个开源的、本地运行的大型语言模型(LLM)生态系统,允许用户在本地设备(如笔记本电脑、台式机)上运行大型语言模型,支持 CPU、NVIDIA 和 AMD GPU,甚至可以在没有网络连接的环境下使用。旨在让用户能够在个人设备上运行强大的 AI 模型,而无需依赖云端服务或联网。

GPT4All可以下载、使用各种开源的大语言模型,包括DeepSeek R1等,也可以使用自定义的PDF、文本文档等数据。GPT4All 所有数据和模型均在本地运行,用户数据不会上传到云端,适合处理敏感信息。支持 Windows、macOS 和 Linux 系统,用户可以根据自己的设备选择合适的版本。

GPT4All 技术原理是基于 Meta 的 LLaMa 模型进行微调,使用了 ChatGPT 生成的问答数据进行训练,旨在通过蒸馏(distillation)技术将大模型的性能压缩到更小的参数量,从而在资源有限的设备上运行。

GPT4All主要的使用场景

离线聊天机器人:用户可以在没有网络的环境下与 GPT4All 进行对话,适用于旅行、飞行等场景。

编程辅助:尽管 GPT4All 在编程任务上的表现不如 在线的ChatGPT、Gemini等,但它仍能提供基本的代码生成和解释功能。

文档分析与写作:用户可以通过 GPT4All 生成文本、总结内容或进行简单的文档分析。

下面是具体的安装过程:

首先访问GPT4All官网下载 合适版本的GPT4All。用WIN10/WIN11就直接下载Windows版本的就好了。

下载、安装过程就不必细说,和普通软件一样。安装完成后,打开软件,进入“查找模型”界面。

直接在GPT4ll版面上可以看到很多已经开源的模型,模型信息可以看到文件大小,需要的RAM大小,参数量等信息。可以按自己的设备和实际需求选择下载。需要科学上网方式才能下载 。

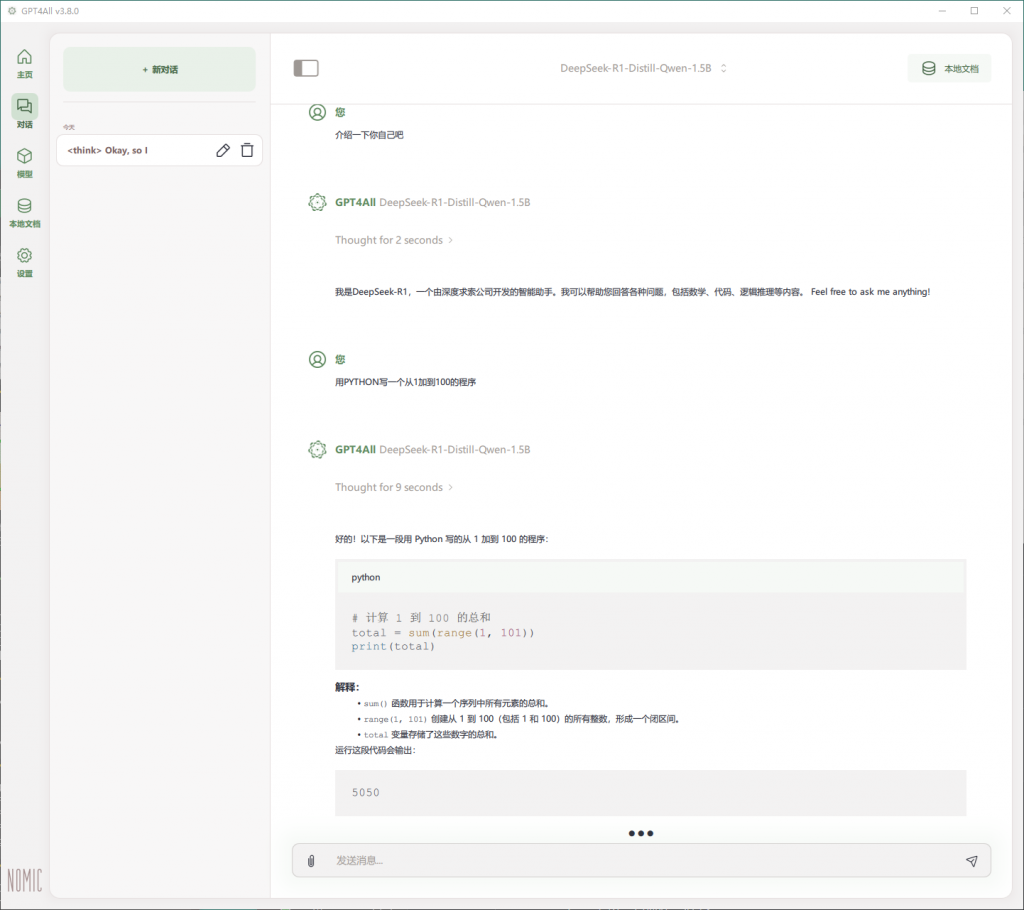

我这里选择了轻量级的DeepSeek-R1-Distill-Qwen-1.5B,用于测试,所需要机器资源小,文件小下载较快。文件约为1GB,所需要RAM为3GB,参数量为1.5亿。如果需要更好的使用,更准确的推理回答,就需要选择文件大的,参数多的模型进行下载,当然所要求的机器资源也更大。

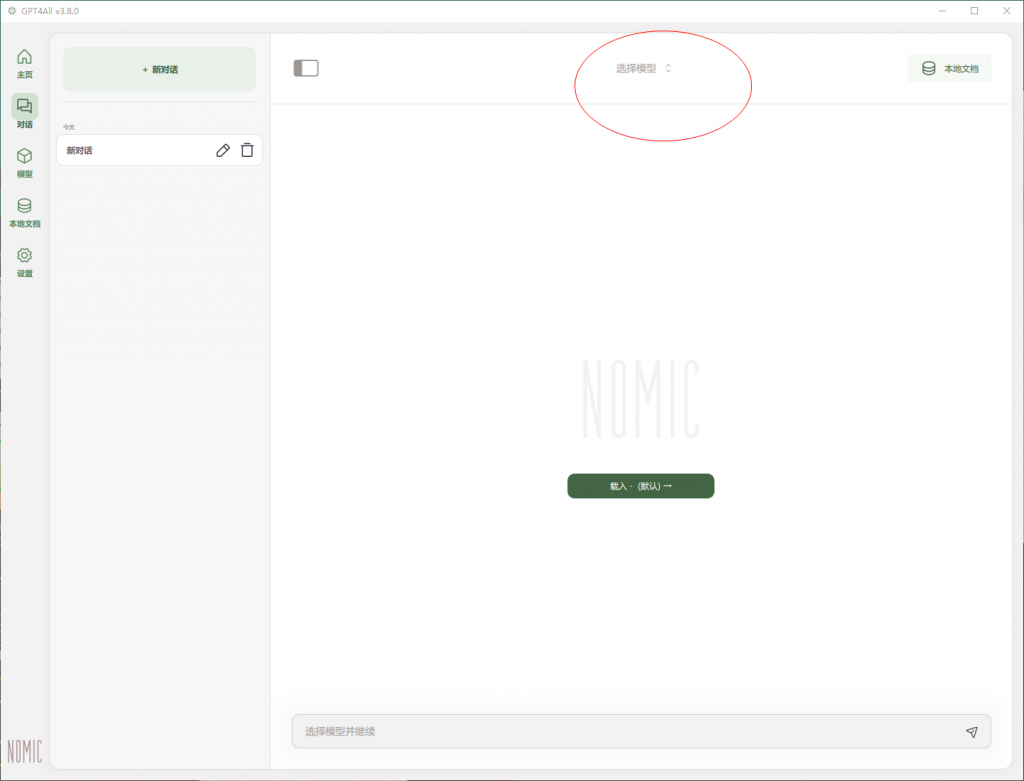

模型下载完成后,在界面左侧进入“对话”,点击“选择模型”选择下载的模型后会自动加载模型。

模型加载完成后就可以进行与AI对话了。这样就有了一个可完全离线的“A助手”了,下载完成后,不需要网络可以直接运行。简单的测试了一下,本地运行的速度还是不错的,也不用担心连网的各种问题。还有自定义数据以及API等功能,需要研究研究,可以用AI模型实现自己想要的功能。

20250205